本篇文章将向大家介绍一篇跨机器人模态的通用策略模型的论文CrossFormer[1]。

在多机器人数据(multi-robot data)上训练单一策略是一个具有挑战的任务,因为机器人的形态,传感器数据,执行器的类别以及相关器件的工作频率等特征多样性使得模型学习到泛化的策略难度增大。这篇文章提出了一个灵活可伸缩的基于Transformer架构的基础策略模型,该模型能够适应接收各种具身机器人(单臂机器人,双臂机器人,轮式机器人,四足机器人,四轴飞行器quadcopters)的异构数据(heterogeneous robot data)作为输入,论文通过充足的实验验证了该模型在性能表现上和针对特定的具身机器人训练的策略模型相当,同时超越了当前最好的跨多种具身机器人学习的模型算法(cross-embodiment learning)。

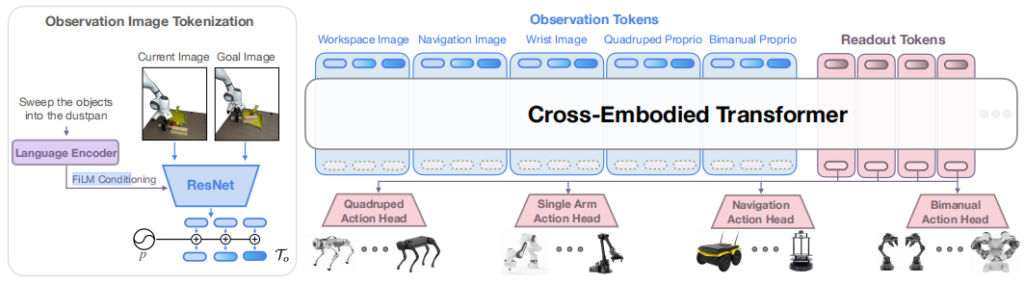

如图所示,该模型借鉴了之前基于Transformer架构训练多模态数据的一些思路,对观测数据和任务描述规范采用模态专属的分词器进行分词后组合成输入tokens序列。骨干网络为基于Transformer的时序因果解码器架构的自回归模型,输出的嵌入(output embeddings)将作为任务相关的head(如图所示有Quadruped Action Head,Single Arm Action Head,Navigation Action Head,Bimanual Action Head)的输入,通过专属head的计算输出为行为相关特定维度的输出。

观测数据主要有外部环境观测数据(如图像和激光点云)以及机器人本体感知观测数据(本体感知观测,Proprioceptive Observations,指的是机器人对自身状态的感知如关节几何夹爪的姿势和机器人部件的物理状态如加速度,角速度,温度等)将这些数据不同模态的观测数据采用不同的分词器进行分词后通过可学习的线性层映射到统一大小维度的词嵌入空间。一般任务的描述和定义用自然语言或全局图像(如导航任务中)或两者结合,语言和图像多模态数据的融合采用FiLM模块[7](RT-1模型也采用的该组件结构)。

在实验室该模型使用了20种不同的具身机器人的数据,具体详细的信息为:(1)Open Cross-Embodiment数据集的单臂机器人操作数据子集[3],该数据自己在Octo算法中被采用;(2)DROID Franka(DROID Distributed Robot Interaction Dataset)机器人操作数据集[4];(3)来自两个组织的7K个ALOHA机器人的轨迹数据ALOHA-multi-task[5];(4)60小时来自GNM数据集的导航数据[6];(5)25分钟的Go1四组机器人行走数据(通过在模拟环境中训练出的专家模型通过Rollout过程收集收据);(6)在实验过程中通过Franka机器人自行收集的200个轨迹数据。

不同数据集的数据通过转化后如数的tokens的序列长度可能不同,和LLM类似采用padding和mask实现不同的数据集的统一训练,transformer的输出embeddings根据输入的type输入到特定任务的head,实现了多个不同机器人不同任务数据的混合训练,实现了backbone参数共享的统一策略的模型。

关于crossformer的代码实现在后续的文章种将进一步进行较为详细的介绍。

References

- [1]、Scaling Cross-Embodied Learning: One Policy for Manipulation, Navigation, Locomotion and Aviation:2408.11812

- [2]、CrossFormer代码实现:rail-berkeley/crossformer

- [3]、Open Cross-Embodiment数据集:Open X-Embodiment: Robotic Learning Datasets and RT-X Models

- [4]、DROID Distributed Robot Interaction Dataset:https://arxiv.org/html/2403.12945v1

- [5]、ALOHA-multi-task: Learning Fine-Grained Bimanual Manipulation with Low-Cost Hardware

- [6]、GNM: A General Navigation Model to Drive Any Robot : https://github.com/robodhruv/drive-any-robot

- [7]、FiLM(Feature-wise Linear Modulation)的实现:Film: Visual reasoning with a general conditioning layer.

Leave a Reply